微信 AI 的 LLM 研究

Hidden Decoding: 在预训练中扩展序列长度

本页目录

在之前的博客中,我们以 WeLM-V4-80B-A3B 为例介绍了预训练环节的架构设计与实践经验。本文旨在介绍一条不同的模型能力提升路径–在不增加 Transformer 主体参数的前提下,通过复制多份 Vocab Embedding 将序列长度扩展 n 倍,使每个 token 在单次前向传播中获得 n 倍的有效计算量。在多个模型规模的实验中,该方法带来了持续的 loss 下降与评测提升,且在较大规模的模型上仅需少量 continue training 步数即可观察到显著收益。

我们已经在Hugging Face开源了基于Qwen3-8B的Dense模型,同时大家可以参考GitHub进行SGLang本地部署。

动机

在序列建模中,模型中间状态(Hidden States)的表达能力决定了模型最终的效果。在模型规模相同的情况下,增加模型的中间状态往往会得到更优的模型效果。例如,采用更窄而深的模型结构 (Kim et al. 2023) 或者 引入 Fine-grained MoE 增加topk数量 (Dai et al. 2024)。

随着 RLVR (DeepSeek-AI 2025) 和各类 Thinking 模型的实践,通过拉长思维链(CoT)(Wei et al. 2022) 来扩展测试时计算(Test-Time Compute)(Snell et al. 2024) 已被证明能极大提升模型的最终回复质量。然而,这种显式推理严重依赖自回归(Auto-Regressive)的串行生成过程。强制模型在离散的"自然语言空间"中思考,不仅带来了漫长的问题解决延迟(Latency),且自然语言本身对于神经网络的内部复杂规划而言,往往是一种低效的信息载体。

为打破离散 Token 生成的限制,一些研究(如 Pause Tokens (Goyal et al. 2024)、Looped Transformers (Giannou et al. 2023) 以及连续思维链 (Hao et al. 2024) 等隐式推理工作)开始探索让模型在连续潜空间(Continuous Latent Space)内进行思考。增加模型在中间状态(Hidden States)的计算深度与激活量(Activation),能够让模型在无需输出实际 Token 的情况下,以更灵活的方式(如隐含的广度优先搜索)探索推理路径。然而,现有的方案往往受限于串行计算或带来显存/内存的剧增。

基于上述背景,我们提出了一种全新的 Scaling 范式——Hidden Decoding。与其单纯依赖纵向加深或横向加宽模型(这会带来高昂的 Activation 存储成本),我们在序列长度(Sequence Length)维度引入并行扩展, 允许模型在潜空间中并行化地累积推理深度。这既保留了长 Context 带来的 Loss 下降与准确度收益,又摆脱了传统 CoT 串行解码的时间惩罚,以高计算访存比实现了推理效率与模型能力的全面提升。

方法

建模过程

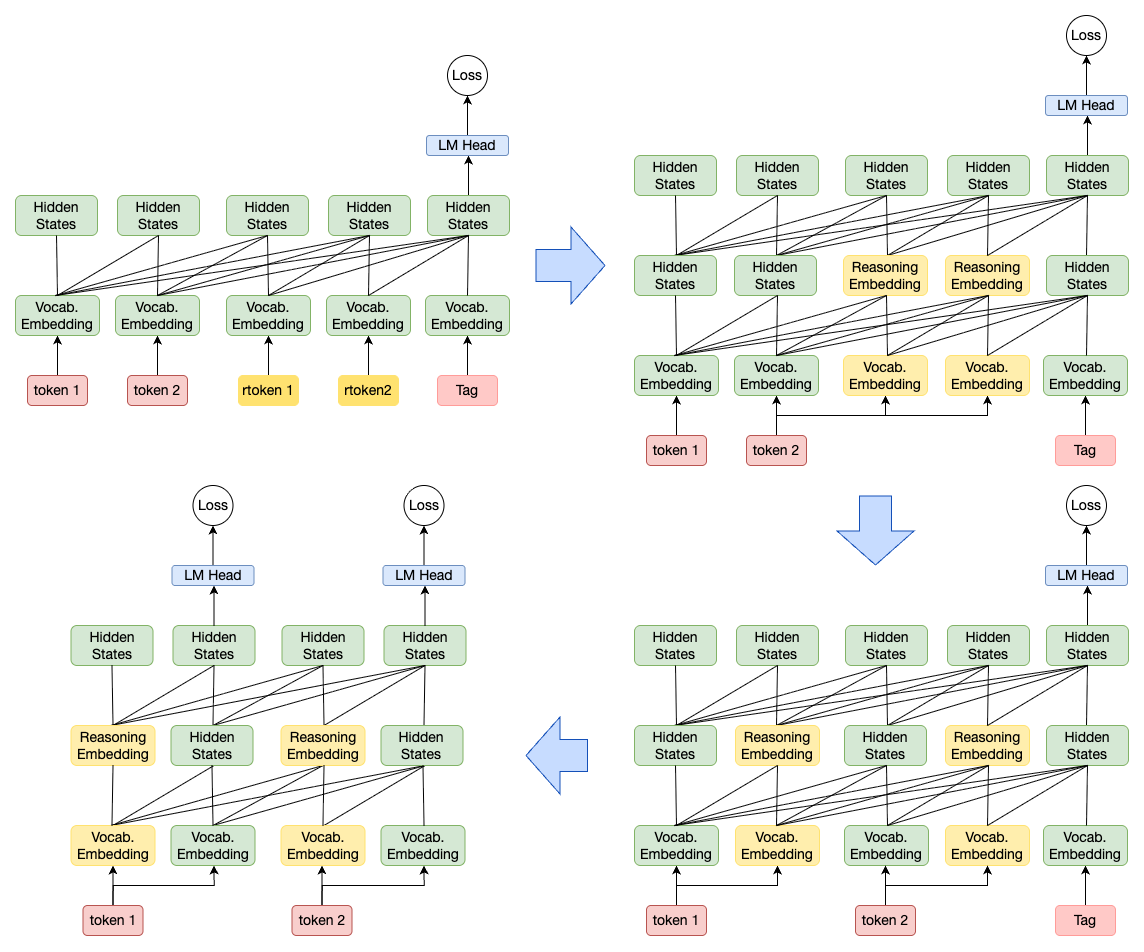

在常见的 thinking 模型中,为了追求答案准确度的提升,通常会在输出端无限制地生成 reasoning token (rtoken) 。模型往往单纯依赖 context 长度的增加来实现模型能力的提升。Hidden Decoding 的核心思想正是打破串行生成的局限:我们使用transformer的输入层在连续潜空间内建模reasoning token的推理表示(reasoning embedding);我们假设推理表示均匀地与前缀 token 相关,进而将推理深度均匀地分配到每个 token,将推理过程"折叠"并重新排列到主序列中。在推理过程中embedding参数由于其低访存特性,我们对其进行低成本地扩展。

图 1:从COT到Hidden Decoding

图 1:从COT到Hidden Decoding

用一句话概括即是:准备 $n$ 个不同的 Embedding 矩阵将同一 token 序列编码 $n$ 遍,交错排列后作为 $n$ 倍长度的序列输入同一个 Transformer。 当我们在预训练中简化 tag 输入并对所有(目标)token 计算 loss 后,便得到了 Hidden Decoding 的最终形式 。在这个过程中,模型在单次前向传播中对每个 token"思考 $n$ 遍"——每一遍都能通过因果注意力(Causal Attention)看到之前所有遍的中间结果,最终的预测取自上下文最丰富的最后一遍($E_n$)。

以 n=2 为例

给定原始 token 序列 $X = (x_1, x_2, \dots, x_L)$,我们引入两个独立的 Embedding 矩阵 $E_1$ 和 $E_2$。将序列按位置交错展开,构造出长度为 $2L$ 的新序列 $S$: $$ S = (E_1(x_1), E_2(x_1), E_1(x_2), E_2(x_2), \dots, E_1(x_L), E_2(x_L)) $$

以序列 [A, B, C] 为例,输入 Transformer 的序列结构如下:

物理位置: 0 1 2 3 4 5

输入序列 S: E₁(A) E₂(A) E₁(B) E₂(B) E₁(C) E₂(C)

RoPE位置: 0 1 2 3 4 5

预测目标: - → B - → C - → D

整个过程采用标准因果注意力(Causal Attention)和连续的旋转位置编码(RoPE)(Su et al. 2024)。模型仅在每个 token 的最后一个 Embedding(即 $E_2$)处计算预测下一个 token 的 Loss,而 $E_1$ 仅参与前向传播。

在这种机制下,不同位置的上下文自然形成了递进关系:

- 位置 0 $E_1(A)$:可见 $\lbrace E_1(A)\rbrace$,进行初步"思考"。

- 位置 1 $E_2(A)$:可见 $\lbrace E_1(A), E_2(A)\rbrace$,基于更丰富的上下文预测 B。

- 位置 2 $E_1(B)$:可见 $\lbrace E_1(A), E_2(A), E_1(B)\rbrace$,继续"思考"。

- 位置 3 $E_2(B)$:可见 $\lbrace E_1(A), E_2(A), E_1(B), E_2(B)\rbrace$,预测 C。

关键性质在于:靠后的 Embedding 总是拥有更丰富的上下文。$E_1$ 负责初步的特征提取与隐式推理,而 $E_2$ 则在吸收了 $E_1$ 的状态后负责最终的预测输出。

推广到一般情况

将上述逻辑推广到任意扩展倍数 $n$:

对于输入序列 $X$,准备 $n$ 个独立的 Embedding 矩阵 $E_1, \dots, E_n$。新序列 $S$ 在物理位置 $t = (i-1)n + (k-1)$ 处的输入为第 $i$ 个 token 的第 $k$ 个 Embedding 表示: $$ S_t = E_k(x_i) \quad (1 \le k \le n) $$

模型在单次前向传播中,采用标准的全因果注意力机制,仅在每个 token 的最后位置 $E_n(x_i)$ 计算交叉熵损失(Cross-Entropy Loss),通过共享的 LM Head 预测 $x_{i+1}$。前 $n-1$ 个 Embedding 作为隐式推理的中间步骤,使得模型在预测每个词前都能获得额外的"思考"深度,实现"先思考,后输出"的建模逻辑。

渐进式扩展

在实践中,高倍率的模型无需从头训练。我们采用**周期性复制初始化(Cyclic Replication Initialization)**策略,允许模型从已收敛的低倍率 Checkpoint 渐进式地扩展至更高倍率。

具体而言,当模型已包含 $n$ 个 Embedding 矩阵 $(E_1, E_2, \dots, E_n)$ 时,若要将其扩展至 $2n$ 倍率,新增的 $n$ 个 Embedding 会直接复用已有矩阵的权重,即 $E_{n+k} \leftarrow E_k \ (1 \le k \le n)$: $$ (E_1, E_2, \dots, E_n) \xrightarrow{\text{扩展至 } 2n} (E_1, \dots, E_n, E_1, \dots, E_n) $$

以常见扩展路径为例:

- $n=2 \to 4$:矩阵权重初始化为 $(E_1, E_2, E_1, E_2)$

- $n=4 \to 8$:矩阵权重初始化为 $(E_1, E_2, E_3, E_4, E_1, E_2, E_3, E_4)$

该策略确保了新增 Embedding 在训练初期的行为与旧 Embedding 保持一致,使模型能在继承已有能力的前提下,平滑过渡并快速适应更高倍率带来的长序列计算。此外,在扩展序列长度时,仅需相应调整 RoPE Base 以适配扩大的位置编码范围即可。

实验

我们在MoE模型train from scratch的基线上对比不同的混合策略,在Dense与较大规模MoE上验证渐进式扩展的效果。

消融结果

保留推理表示(Reasoning Embedding)的生成自由度对模型的最终表现至关重要。我们在实验中对比了以下两种变体,它们均对潜空间中的"思考"过程构成了额外约束,从而在训练 Loss 和下游评测中表现出负向效果:

- All Token Loss:在序列中的每一个位置 $S_t = E_k(x_i) \ (1 \le k \le n)$ 都计算预测下一个 token 的交叉熵损失。这会强制所有中间计算步骤(如 $E_1, \dots, E_{n-1}$)提前去拟合最终输出,剥夺了它们作为纯粹隐式推理状态的自由度。

- Sum:不单独依赖最后一遍的输出,而是将同一个 token 所有 Embedding 对应位置的输出状态进行求和聚合,再计算 Loss。这种处理强行绑定了各阶段的输出,抹除了不同深度上下文之间的递进关系,削弱了 $E_n$ 汇聚最终推理结果的能力。

图 2:All Token Loss 与 Sum 变体示意

图 2:All Token Loss 与 Sum 变体示意

28 层,6B 参数,0.6B 激活参数,209B tokens,AdamW,batch size = 1024, max_lr=8e-4

| 方法 | Loss | MMLU | ARC-C | C-Eval | CMMLU |

|---|---|---|---|---|---|

| (1) Baseline | 1.908 | 53.4 | 68.7 | 58.4 | 61.2 |

| (2) all token loss, n=2 | 1.880 | 55.5 | 65.8 | 59.1 | 63.2 |

| (3) sum, n=2 | 1.877 | 55.6 | 71.9 | 61.0 | 63.3 |

| (4) Hidden Decoding, n=2 | 1.874 | 56.5 | 74.3 | 61.2 | 63.7 |

| (4) Hidden Decoding, n=3 | 1.857 | 58.5 | 75.7 | 62.5 | 65.9 |

表 1:在 6B 配置上的消融结果。

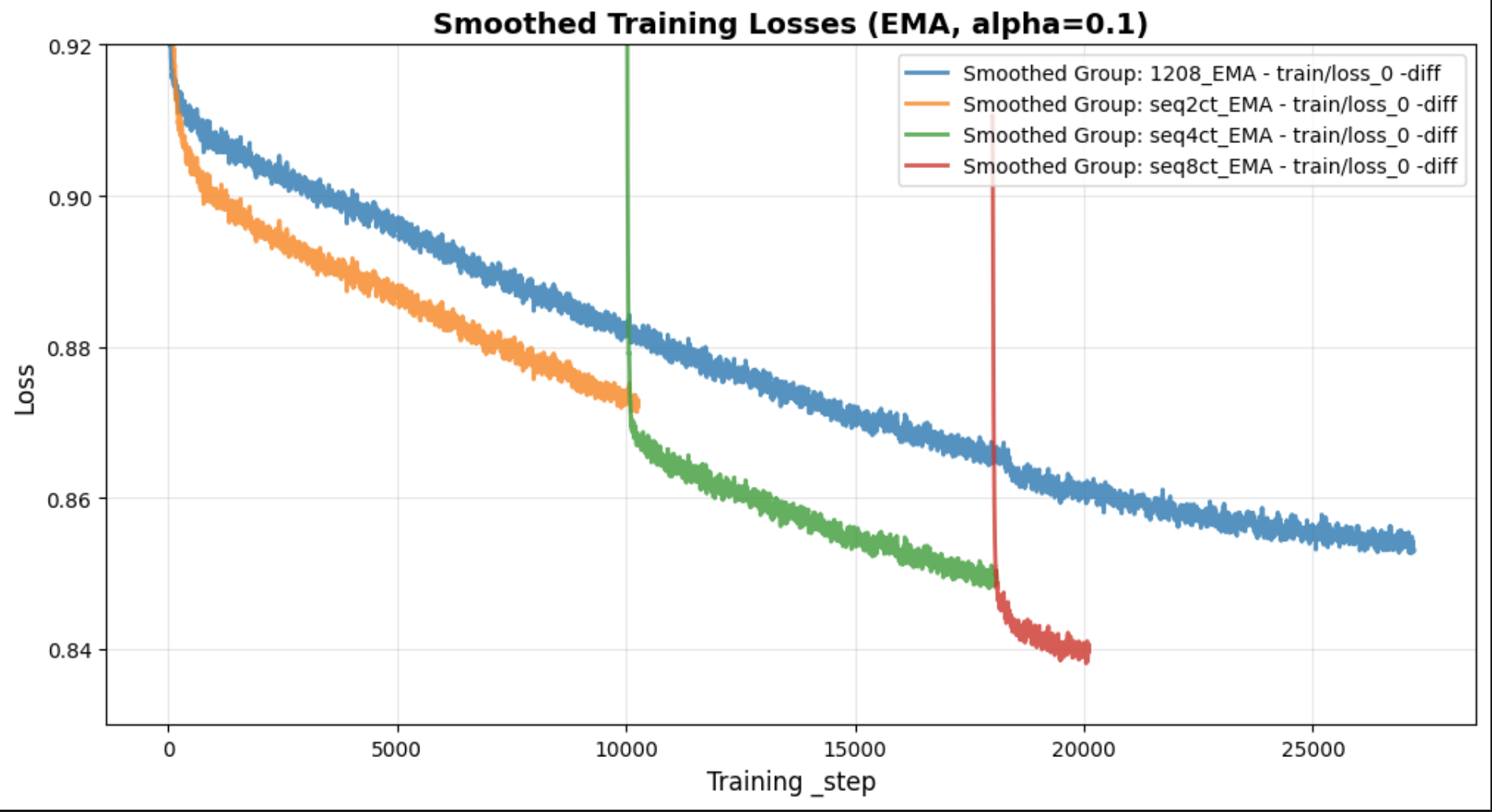

在较大规模模型上的渐进式扩展

我们在WeLM-V4-80B-A3B 1.4T 高质量tokens annealing 阶段引入渐进式扩展,训练数据及超参数配置完全对齐,由于未进行context extension,上下文长度保持在4k,sft阶段通过YaRN (Peng et al. 2024) 等方式扩展至16k。

在训练过程上,我们在分别在0B,503B,906B 进行2倍,4倍,8倍的渐进式扩展,在4倍与8倍扩展时,分别将rope base 扩展至100k与500k。在训练loss的曲线上,展现出了较快的收敛速度,在预训练指标上展现出了明显的提升。

图 3:WeLM-V4-80B-A3B train/loss

图 3:WeLM-V4-80B-A3B train/loss

| 基准(指标) | # Shots | 80B Baseline | 80B scale n=2 | 80B scale n=4 | 80B scale n=8 |

|---|---|---|---|---|---|

| 激活参数量 per token | - | 3B | 3B | 3B | 3B |

| 总参数量 | - | 80B | 80B | 80B | 80B |

| Embedding 参数量 | - | 6.1B | 12.1B | 24.2B | 48.4B |

| 训练 tokens 数 | - | 1.37T | 503B | 906B | 1.01T |

| Pile-test (BPB) | - | 0.386 | 0.387 | 0.382 | 0.378 |

| BBH (EM) | 3-shot | 87.5 | 88.3 | 90.0 | 90.6 |

| MMLU (EM) | 5-shot | 85.1 | 85.0 | 86.7 | 87.5 |

| C-Eval (EM) | 5-shot | 88.8 | 88.9 | 89.9 | 89.5 |

| SimpleQA (LLM-judge) | 5-shot | 16.7 | 15.1 | 17.2 | 18.4 |

| 中文 SimpleQA (LLM-judge) | 5-shot | 60.7 | 62.2 | 63.8 | 64.7 |

| HumanEval+ (Pass@1) | 1-shot | 61.0 | 61.0 | 59.1 | 62.2 |

| MBPP+ (Pass@1) | 1-shot | 67.7 | 64.4 | 70.2 | 71.2 |

| MATH (LLM-judge) | 4-shot | 60.4 | 58.4 | 71.4 | 71.7 |

表 2:在 80B 配置上渐进式扩展的结果。

与模型的深度扩展 (Kim et al. 2023) 类似,Hidden Decoding 模型呈现出了与基础检查点不同的输出模式,我们比较了 基线 和 scale n=8 两个变体在不同领域的 token 级输出熵,结果汇总如下

| Domain | Model | Avg. Entropy | Entropy Std. |

|---|---|---|---|

| Chinese | 80B-A3B | 0.8009 | 0.4369 |

| 80B-A3B-Scale8 | 0.5674 | 0.4139 | |

| English | 80B-A3B | 0.9882 | 0.4605 |

| 80B-A3B-Scale8 | 0.7638 | 0.5629 | |

| Code | 80B-A3B | 0.6417 | 0.2426 |

| 80B-A3B-Scale8 | 0.3389 | 0.3351 | |

| Math | 80B-A3B | 0.2983 | 0.2117 |

| 80B-A3B-Scale8 | 0.2544 | 0.1898 |

在所有领域上Hidden Decoding 模型均表现出较低的平均熵,这表明在大多数领域中输出多样性有所降低,方差则呈现出了不同的变化。在过往的实践中模型输出的多样性往往需要高强度的RL将其兑现为pass@1效果上的提升;Hidden Decoding的渐进式扩展提供了一条更为直接的效果转换方式。在实践中,经过简单sft后,Hidden Decoding 模型展现出了惊人的文学创作能力,呈现在下面的例子中

以汾河为题赋一篇陆机风格的骈文

# 汾 河 赋

---

惟大晋之御宇,迈三五而齐声。眷中条之奥壤,览汾水之英精。尔其发源管涔,导脉云中;北临燕代之塞,南注孟门之洪。经平陶而迤逦,历晋阳而溶溶。控汾浍之流派,带霍太之崇峰。斯固唐叔之旧壤,有周之所经营者也。

若乃春阳载候,青阳启节。冰泮霞舒,川容镜澈。鸿雁嗷以遵渚,鲔鲂跃而吹沫。原隰骧首以怀新,畎浍含润而流泽。及其朱明戒序,祝融司方;绿杨荫渚,翠荇分塘。渔讴互起于烟浦,菱歌间发于回塘。虽河渭之广博,曾何足以方。

若夫金商应律,玉琯飞灰。霜凄蔓草,风劲高槐。天吴怵以屏迹,阳侯骇而潜隈。于是旅人怨别,思妇含悲;望归云之悠悠,听朔吹之凄其。感三闾之遗叹,愍中林之变衰。彼川流之不辍,岂人事之足追。

尔其控引群渎,朝宗于河。溉汾阴之沃野,浸涑水之嘉禾。盐池映其左纡,首阳峙其右阿。瞻姑射之神岫,想唐尧之逝波。美哉洋洋,实晋国之巨浸也。

---

* 仿陆机《文赋》《豪士赋》骈俪之体,辞尚敷陈,义取比兴。Hidden Decoding Scale N=4, non-thinking

在传统的Dense 模型上,Hidden Decoding同样带来了可观的效果提升,在实践中我们以Qwen3-8B-Base (Yang et al. 2025) 模型作为基线,同样进行了渐进式扩展,其结果汇总于下:

| 基准(指标) | # Shots | 8B Baseline | 8B scale n=2 | 8B scale n=4 | 8B scale n=8 |

|---|---|---|---|---|---|

| 总参数量 | - | 8B | 8B | 8B | 8B |

| Embedding 参数量 | - | 1.2B | 1.9B | 3.1B | 5.6B |

| 训练 tokens 数 | - | 180B | 75B | 150B | 187B |

| BBH (EM) | 3-shot | 78.8 | 81.3 | 83.0 | 83.9 |

| MMLU (EM) | 5-shot | 79.8 | 80.9 | 81.9 | 82.2 |

| MBPP+ (Pass@1) | 1-shot | 66.7 | 69.4 | 68.7 | 69.4 |

| MATH (LLM-judge) | 4-shot | 56.0 | 58.2 | 60.0 | 61.1 |

| ARC-C | 25-shot | 93.9 | 94.3 | 94.4 | 94.7 |

| Hellaswag | 10-shot | 79.7 | 83.1 | 85.0 | 85.3 |

| GSM8K | 4-shot | 92.5 | 93.3 | 93.9 | 94.6 |

结论与展望

本文介绍了一种全新的 Scaling 范式——Hidden Decoding。通过在序列长度维度引入并行扩展,模型在不增加 Transformer 主体网络参数的前提下,以高计算访存比实现了单次前向传播中有效计算量的成倍增加。结合周期性复制初始化(Cyclic Replication Initialization)策略,我们证明了模型可以从已收敛的基线平滑过渡,并在多种参数规模(涵盖 Dense 和 MoE 架构)上取得了一致的 Loss 下降与下游核心指标的显著提升。

未来,我们将围绕以下几个方向对 Hidden Decoding 展开更深入的研究:

- 与显式推理(CoT)的融合:隐式潜空间推理与显式自然语言推理在模型规划能力上具有高度互补性,我们计划探索如何有效结合这两种机制以触达更高的能力上限。

- 推理加速与工程优化:尽管 Hidden Decoding 在训练阶段能以极低成本堆叠推理深度,并通过并行计算控制了推理延迟的上涨速度,但序列长度的成倍增长不可避免地会增加长文下模型的推理延迟。后续可通过底层算子优化、动态token管理,kv cache共享 (Sun et al. 2024; Wu et al. 2024) 以及compressed attention等技术来进一步提升线上部署的吞吐效率。

- 多模态与更广阔的应用场景:进一步探索利用多个独立 Embedding 在跨模态特征对齐(如视觉、音频特征的隐式对齐)以及超长上下文场景中的潜力与应用边界。

References

Dai, Damai, Chengqi Deng, Chenggang Zhao, et al. 2024. “Deepseekmoe: Towards Ultimate Expert Specialization in Mixture-of-Experts Language Models.” arXiv Preprint arXiv:2401.06066.

DeepSeek-AI. 2025. “DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning.” arXiv Preprint arXiv:2501.12948.

Giannou, Angeliki, Shashank Rajput, Jy-yong Sohn, Kangwook Lee, Jason D Lee, and Dimitris Papailiopoulos. 2023. “Looped Transformers as Programmable Computers.” arXiv Preprint arXiv:2301.13196.

Goyal, Sachin, Ziwei Ji, Ankit Singh Rawat, Aditya Krishna Menon, Sanjiv Kumar, and Sharan Narang. 2024. “Think Before You Speak: Training Language Models with Pause Tokens.” The Twelfth International Conference on Learning Representations.

Hao, Shibo, Sainbayar Gu, Haotian Ma, et al. 2024. “Training Large Language Models to Reason in a Continuous Latent Space.” arXiv Preprint arXiv:2412.06769.

Kim, Dahyun, Chanjun Park, Sangdoo Kim, Wonsung Lee, Sunghyun Kim, and Yungi Ahn. 2023. “Solar 10.7b: Scaling Large Language Models with Simple Depth up-Scaling.” arXiv Preprint arXiv:2312.15166.

Peng, Bowen, Jeffrey Quesnelle, Honglu Fan, and Enrico Shippole. 2024. “YaRN: Efficient Context Window Extension of Large Language Models.” The Twelfth International Conference on Learning Representations.

Snell, Charlie, Jaehoon Lee, Kelvin Xu, and Aviral Kumar. 2024. “Scaling LLM Test-Time Compute Optimally Can Be More Effective Than Scaling Model Parameters.” arXiv Preprint arXiv:2408.03314.

Su, Jianlin, Murtadha Ahmed, Yu Lu, Shengfeng Pan, Wen Bo, and Yunfeng Liu. 2024. “Roformer: Enhanced Transformer with Rotary Position Embedding.” Neurocomputing 568: 127063.

Sun, Yutao, Li Wang, Yaru Cui, et al. 2024. “You Only Cache Once: Decoder-Decoder Architectures for Language Models.” arXiv Preprint arXiv:2405.05254.

Wei, Jason, Xuezhi Wang, Dale Schuurmans, et al. 2022. “Chain-of-Thought Prompting Elicits Reasoning in Large Language Models.” Advances in Neural Information Processing Systems 35: 24824–37.

Yang, An, Anfeng Li, Baosong Yang, et al. 2025. Qwen3 Technical Report. https://arxiv.org/abs/2505.09388.